Datenverarbeitung

Datenverarbeitung ist die systematische Abfolge von Aktionen, die auf Rohdaten angewendet werden, um sie in strukturierte, umsetzbare Informationen für Analysen...

Datenübertragung ist der Prozess der Verlagerung, Kopierung oder Übertragung von Daten zwischen digitalen Umgebungen und ist entscheidend für Kontinuität, Analytik und Compliance.

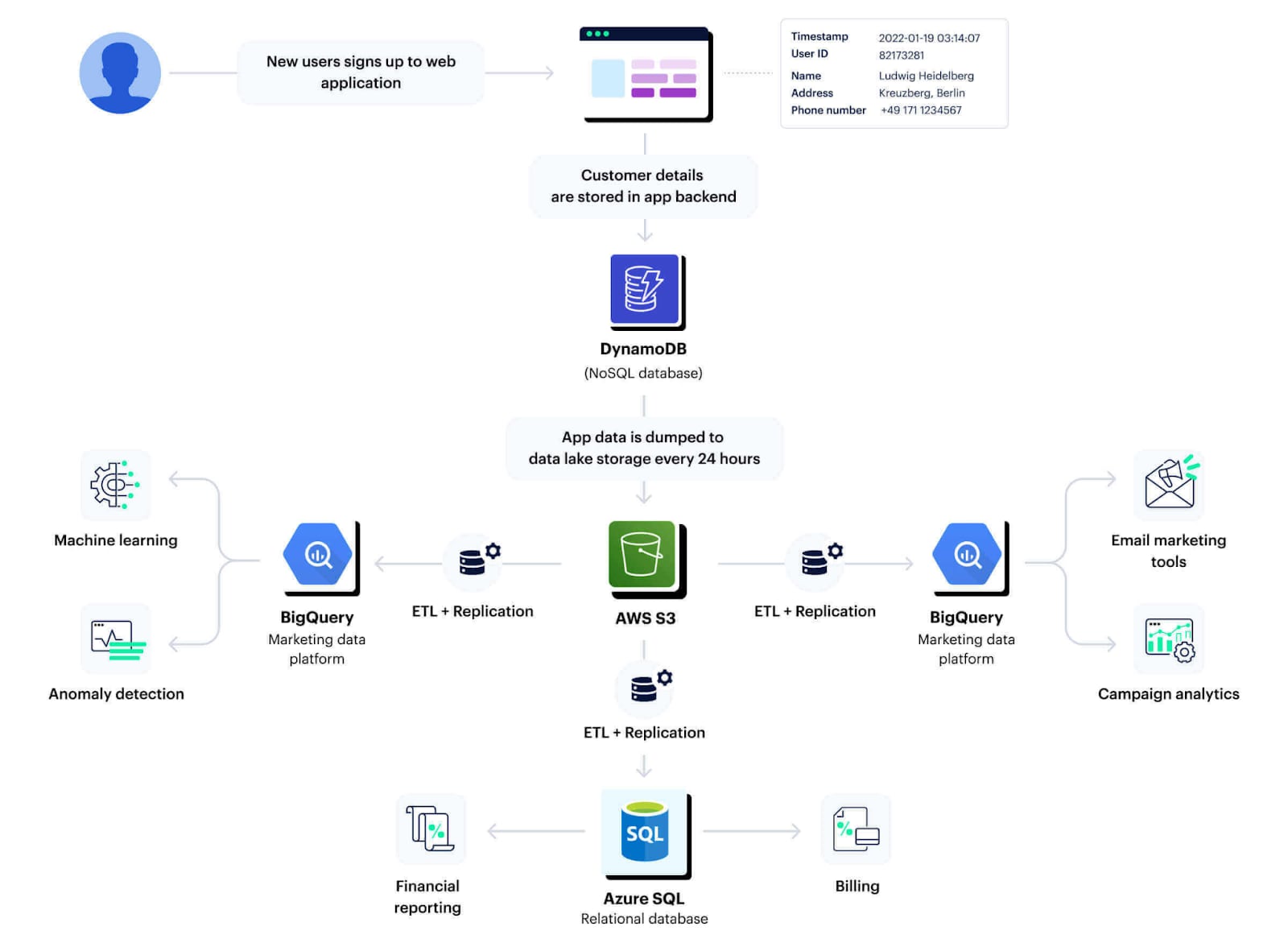

Datenübertragung, auch bekannt als Datenbewegung, ist der umfassende Prozess der Verlagerung, Kopierung oder Übertragung von Daten von einer digitalen Umgebung in eine andere. Dazu gehören Aktivitäten wie die Migration von Daten zwischen Speichergeräten, der Transfer von Datensätzen zwischen Datenbanken und Servern, die Synchronisation von Daten zwischen lokalen und Cloud-Plattformen sowie das Streaming von Informationen über Anwendungen und geografische Grenzen hinweg. Die Datenübertragung ist grundlegend für die moderne Informationstechnologie und unterstützt alles von der betrieblichen Kontinuität bis hin zu groß angelegter Analytik und regulatorischer Compliance.

Ob strukturierte Daten aus einer relationalen Datenbank, unstrukturierte Dateien aus einem verteilten Dateisystem oder Zeitreihen-Sensordaten aus IoT-Geräten übertragen werden—die Datenübertragung bildet das Fundament geschäftskritischer und operativer Prozesse. Sie ermöglicht funktionsübergreifenden Teams den Zugriff auf aktuelle Informationen, gewährleistet die Resilienz der IT-Infrastruktur durch Redundanz und unterstützt Multi-Cloud- sowie Hybrid-Cloud-Umgebungen, indem sie einen nahtlosen Datenfluss zwischen unterschiedlichen Systemlandschaften ermöglicht. Da das Datenvolumen exponentiell wächst, sind effiziente und sichere Strategien zur Datenübertragung unerlässlich, um den Betrieb zu skalieren, Kosten zu optimieren und sich ändernden regulatorischen Anforderungen zu entsprechen.

Die Bewegung von Daten ist essenziell für die operative Effizienz, die geschäftliche Agilität und die digitale Transformation. Nahtloser Informationszugriff stellt sicher, dass Beteiligte—von Entscheidungsträgern bis zu automatisierten Systemen—mit genauen, aktuellen Daten arbeiten. Dies ist besonders in verteilten Organisationen kritisch, in denen Daten in mehreren Rechenzentren, Cloud-Plattformen oder Edge-Geräten gespeichert sein können.

Um Datenintegrität und Konsistenz zu wahren, beinhalten Datenbewegungslösungen Validierung, Fehlerprüfung und Abgleichsprozesse—damit Daten stets korrekt und aktuell bleiben.

Datenbewegung umfasst ein Spektrum von Aktivitäten, die jeweils eine besondere Rolle in der Datenstrategie eines Unternehmens spielen:

Datenbewegung unterscheidet sich vom Datenfluss, der den logischen Pfad und die Verarbeitungsschritte beschreibt, die Daten in einem System durchlaufen.

Datenmigration ist der systematische Prozess der Übertragung von Daten zwischen Umgebungen, Anwendungen oder Speichermedien. Häufig im Rahmen der IT-Modernisierung, Cloud-Einführung oder Außerbetriebnahme von Altsystemen eingesetzt, umfasst die Migration Erkennung, Zuordnung, Transformation, Validierung und Ausführung. Änderungen in Struktur, Format oder Codierung können erforderlich sein, und robuste Wiederherstellungsmechanismen minimieren Risiken.

Replikation kopiert und pflegt Datensätze über mehrere Systeme oder Standorte hinweg. Sie erhöht die Verfügbarkeit und Fehlertoleranz, unter Verwendung synchroner oder asynchroner Strategien. Datenbankreplikation (z. B. Oracle Data Guard, SQL Server Always On) unterstützt Hochverfügbarkeit und Notfallwiederherstellung, während Cloud-Architekturen Replikation für Compliance und geringe Latenz nutzen.

Synchronisation hält Daten über Systeme hinweg konsistent und aktuell. Change Data Capture (CDC) identifiziert und überträgt nur Änderungen, was eine nahezu Echtzeit-Konsistenz ermöglicht. Tools wie Oracle GoldenGate, AWS DMS und Debezium bieten robuste CDC-Funktionen.

Datenintegration kombiniert Daten aus unterschiedlichen Quellen für eine einheitliche Analyse oder operative Nutzung. Lösungen bieten Konnektoren, Transformationen und Datenbereinigung für konsistente Datensätze—entscheidend für die Auflösung von Datensilos und die Ermöglichung von Analysen.

Datenstreaming ist die Echtzeitübertragung und -verarbeitung von Ereignisdaten. Plattformen wie Apache Kafka und Amazon Kinesis ermöglichen es Unternehmen, Daten im Fluss zu erfassen, zu verarbeiten und zu analysieren—für sofortige Reaktionen und Echtzeiteinblicke.

Die Datenaufnahme sammelt und importiert Daten aus verschiedenen Quellen in zentrale Speichersysteme (Data Lakes, Warehouses). Tools wie Logstash, AWS Glue und Google Cloud Dataflow bieten robuste Pipelines für skalierbare Analysen.

ETL (Extract, Transform, Load) und ELT (Extract, Load, Transform) sind Methoden, um Daten von Quellen in Zielsysteme zu bewegen, meist für Analytik. ETL transformiert Daten vor dem Laden; ELT lädt Daten und transformiert sie anschließend im Zielsystem. Beide Ansätze werden mit modernen Data-Pipeline-Tools orchestriert.

Reverse ETL verschiebt Daten aus analytischen Speichern zurück in operative Systeme, sodass Geschäftsanwendungen aktuelle Erkenntnisse für den täglichen Betrieb nutzen können.

Protokolle definieren die Regeln für den Datenaustausch zwischen Systemen:

ICAO- und Branchenrichtlinien fordern sichere, authentifizierte Protokolle, Verschlüsselung während der Übertragung und detaillierte Protokollierung.

Ein robustes Ökosystem an Tools unterstützt die Datenbewegung und ist auf spezifische Anforderungen zugeschnitten:

Die Auswahl richtet sich nach Kompatibilität, Sicherheit, Skalierbarkeit und Benutzerfreundlichkeit.

In der Luftfahrt schreibt die Internationale Zivilluftfahrtorganisation (ICAO) strenge Protokolle für die Datenbewegung vor—mit Fokus auf Datenintegrität, Nachverfolgbarkeit, Verschlüsselung und Validierung. Diese Standards gewährleisten Sicherheit, Zuverlässigkeit und Compliance beim Umgang mit betrieblichen, Wartungs- und regulatorischen Daten. Ähnlich hohe Anforderungen gelten in Gesundheitswesen, Finanzen und anderen regulierten Sektoren.

Datenübertragung (Datenbewegung) ist ein strategischer Enabler für das digitale Geschäft und unterstützt Resilienz, Agilität und Compliance. Während Organisationen ihre IT-Infrastruktur modernisieren und den Betrieb skalieren, sind robuste, sichere und effiziente Strategien zur Datenbewegung entscheidend für den Geschäftserfolg.

Für fachkundige Beratung zu Datenübertragungslösungen kontaktieren Sie unser Team oder buchen Sie eine Demo, um zu sehen, wie Ihr Unternehmen von moderner, automatisierter Datenbewegung profitieren kann.

Datenübertragung, auch bekannt als Datenbewegung, ist der Prozess des Verschiebens, Kopierens oder Übertragens von Daten zwischen digitalen Umgebungen—wie Datenbanken, Speichersystemen, Cloud-Plattformen oder Anwendungen. Dazu gehören Aktivitäten wie Migration, Replikation, Synchronisation, Integration, Streaming und Ingestion, um sicherzustellen, dass Daten über verschiedene Systeme hinweg zugänglich, konsistent und sicher bleiben.

Datenbewegung ist entscheidend für die Sicherstellung der Geschäftskontinuität, ermöglicht plattformübergreifende Analytik, unterstützt die Notfallwiederherstellung, gewährleistet die Einhaltung von Vorschriften und treibt die digitale Transformation voran. Sie erlaubt es Organisationen, aktuelle Informationen zu nutzen, Altsysteme und moderne Systeme zu integrieren und sich schnell von Störungen zu erholen.

Die Haupttypen sind Migration (Verschiebung von Daten zwischen Systemen), Replikation (Erstellung von Kopien für hohe Verfügbarkeit), Synchronisation (Wahrung der Konsistenz zwischen Systemen), Integration (Zusammenführung von Daten aus mehreren Quellen), Streaming (Echtzeitdatenfluss), Ingestion (Konsolidierung von Daten in zentrale Speicher), ETL/ELT (Extract, Transform, Load), und Reverse ETL (Verschieben von Daten aus Analyseplattformen in operative Systeme).

Herausforderungen beinhalten die Sicherstellung von Datensicherheit und Datenschutz, Wahrung der Datenintegrität und Konsistenz, Minimierung von Ausfallzeiten während der Migration, Umgang mit großen Datenmengen und -geschwindigkeiten, Verwaltung von Schema- oder Formatänderungen, Konfliktlösung in verteilten Umgebungen und Einhaltung branchenspezifischer Vorschriften.

Zu den Protokollen gehören SFTP, HTTPS, SMB, NFS und proprietäre Cloud-APIs, die verschlüsselte und authentifizierte Übertragungen gewährleisten. Zu den gängigen Tools gehören AWS DMS, Oracle GoldenGate, Talend, Informatica, Apache Kafka, Fivetran und viele andere, die jeweils auf spezifische Anforderungen wie Replikation, Integration, Streaming und Migration zugeschnitten sind.

Bereit, Ihre Datenübertragungslösungen zu modernisieren? Verbessern Sie Resilienz, Effizienz und Compliance mit sicherer, automatisierter Datenbewegung über Plattformen und Clouds hinweg.

Datenverarbeitung ist die systematische Abfolge von Aktionen, die auf Rohdaten angewendet werden, um sie in strukturierte, umsetzbare Informationen für Analysen...

Erkunden Sie umfassende Definitionen und Best Practices für Datenspeicherung und -aufbewahrung, einschließlich Richtlinien, Technologien, regulatorischer Rahmen...

Die Datenübertragungsrate (DTR) definiert die Geschwindigkeit, mit der digitale Daten über Kommunikationskanäle übertragen werden. Sie ist entscheidend für Netz...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.