Débit de transfert de données (DTR)

Le débit de transfert de données (DTR) définit la vitesse à laquelle les données numériques circulent à travers les canaux de communication, essentiel pour les ...

Le transfert de données est le processus de déplacement, de copie ou de transmission de données entre des environnements numériques, essentiel pour la continuité, l’analytique et la conformité.

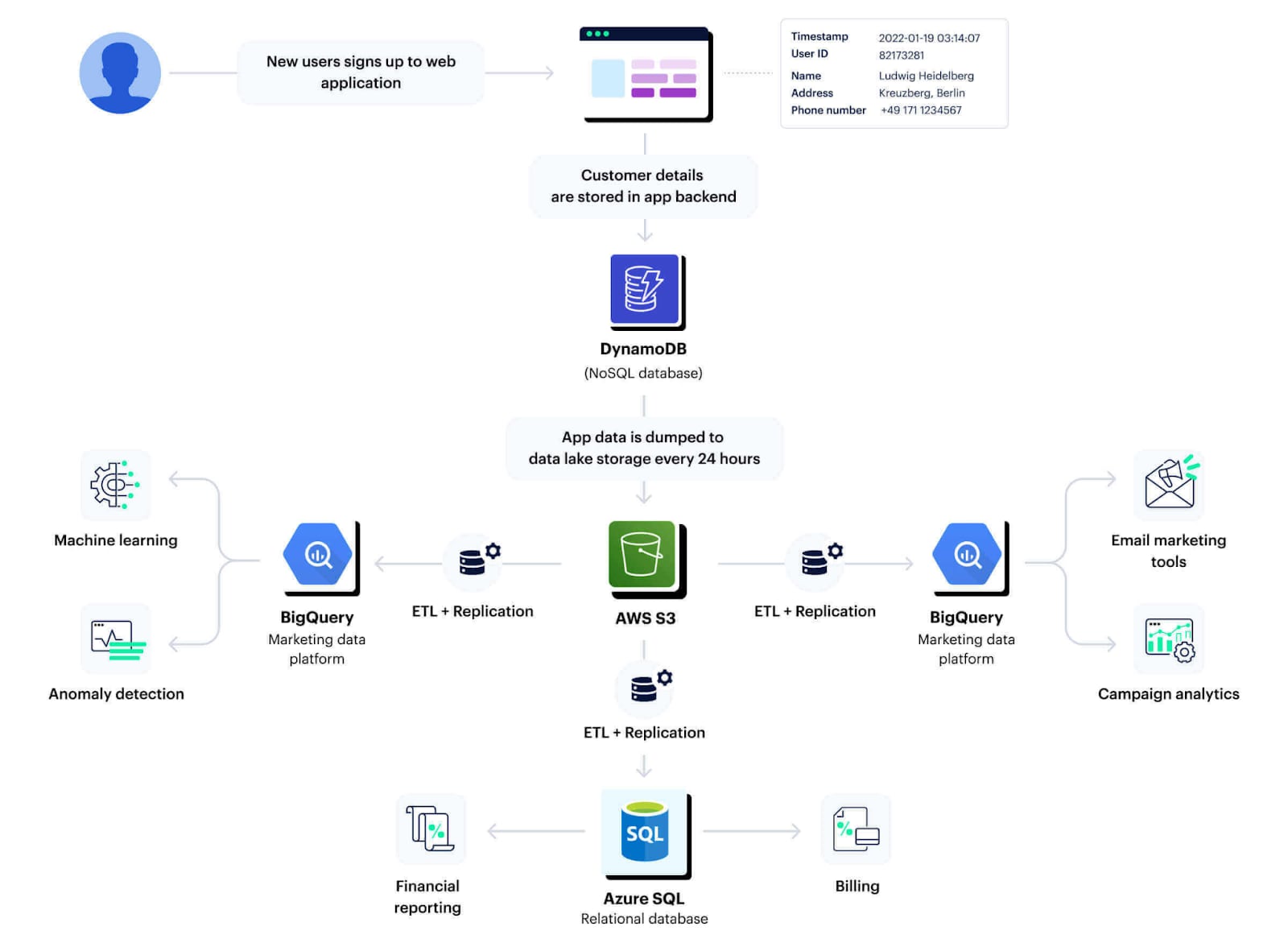

Le transfert de données, également appelé mouvement de données, est le processus complet de déplacement, de copie ou de transmission de données d’un environnement numérique à un autre. Cela inclut des activités comme la migration de données entre dispositifs de stockage, le transfert d’enregistrements entre bases de données et serveurs, la synchronisation de données entre plateformes sur site et cloud, et le streaming d’informations entre applications et frontières géographiques. Le transfert de données est fondamental pour les technologies de l’information modernes, soutenant tout, de la continuité opérationnelle à l’analytique à grande échelle et à la conformité réglementaire.

Qu’il s’agisse de déplacer des données structurées d’une base de données relationnelle, des fichiers non structurés depuis un système de fichiers distribué, ou des données de capteurs en série temporelle issues de dispositifs IoT, le transfert de données sous-tend des processus opérationnels et métiers critiques. Il permet aux équipes transverses d’accéder à des informations à jour, assure la résilience de l’infrastructure informatique grâce à la redondance, et prend en charge les déploiements multi-cloud et hybrides en facilitant un flux de données fluide entre des environnements divers. À mesure que les volumes de données continuent de croître de façon exponentielle, des stratégies de transfert de données efficaces et sécurisées sont essentielles pour faire évoluer les opérations, optimiser les coûts et répondre aux exigences réglementaires en évolution.

Le mouvement des données est essentiel à l’efficacité opérationnelle, à l’agilité des entreprises et à la transformation numérique. Un accès fluide à l’information garantit que les parties prenantes—des décideurs aux systèmes automatisés—opèrent avec des données précises et en temps réel. Cela est particulièrement crucial dans les organisations distribuées, où les données peuvent résider dans plusieurs centres de données, plateformes cloud, ou dispositifs périphériques.

Pour maintenir l’intégrité et la cohérence des données, les solutions de mouvement de données intègrent des processus de validation, de contrôle d’erreurs et de rapprochement—garantissant des données précises et à jour.

Le mouvement de données recouvre un éventail d’activités, chacune jouant un rôle unique dans la stratégie data de l’organisation :

Le mouvement de données diffère du flux de données, qui fait référence au chemin logique et à la séquence de traitement des données dans un système.

La migration de données est le processus systématique de déplacement des données entre des environnements, applications ou supports de stockage. Courante lors de la modernisation informatique, de l’adoption du cloud ou du retrait de systèmes existants, la migration implique la découverte, la cartographie, la transformation, la validation et l’exécution. Des changements de structure, de format ou d’encodage peuvent être nécessaires, et des mécanismes de reprise robustes minimisent les risques.

La réplication copie et maintient des jeux de données sur plusieurs systèmes ou emplacements. Elle améliore la disponibilité et la tolérance aux pannes, via des stratégies synchrones ou asynchrones. La réplication de bases de données (par exemple, Oracle Data Guard, SQL Server Always On) assure une haute disponibilité et la reprise après sinistre, tandis que les architectures cloud s’appuient sur la réplication pour la conformité et la faible latence.

La synchronisation maintient des données cohérentes et à jour entre les systèmes. La CDC (Capture de Données de Modification) identifie et propage uniquement les changements, permettant une cohérence quasi temps réel. Des outils comme Oracle GoldenGate, AWS DMS ou Debezium offrent des fonctionnalités CDC robustes.

L’intégration de données combine des données issues de sources diverses pour une analyse unifiée ou une utilisation opérationnelle. Les solutions proposent des connecteurs, des transformations et du nettoyage pour garantir un ensemble cohérent—crucial pour casser les silos de données et permettre l’analytique.

Le streaming de données est le transfert et le traitement en temps réel de données d’événements. Des plateformes comme Apache Kafka ou Amazon Kinesis permettent aux organisations d’ingérer, traiter et analyser les données à la volée, pour des réponses instantanées et des analyses en temps réel.

L’ingestion collecte et importe des données de sources multiples dans des systèmes de stockage centralisés (lacs ou entrepôts de données). Des outils comme Logstash, AWS Glue ou Google Cloud Dataflow offrent des pipelines d’ingestion robustes pour une analytique évolutive.

L’ETL (Extraction, Transformation, Chargement) et l’ELT (Extraction, Chargement, Transformation) sont des méthodologies de préparation et de transfert de données des sources vers les cibles, généralement pour l’analytique. L’ETL transforme les données avant le chargement ; l’ELT les charge avant de les transformer dans le système cible. Les deux sont orchestrés via des outils modernes de pipelines data.

Le Reverse ETL transfère les données des entrepôts analytiques vers les systèmes opérationnels, afin que les applications métiers puissent exploiter des informations à jour au quotidien.

Les protocoles définissent les règles d’échange de données entre systèmes :

L’OACI et les directives du secteur exigent des protocoles sécurisés et authentifiés, un chiffrement en transit et une journalisation détaillée.

Un écosystème robuste d’outils prend en charge le mouvement de données, adapté à des besoins spécifiques :

La sélection dépend de la compatibilité, la sécurité, l’évolutivité et la facilité d’utilisation.

Dans l’aviation, l’Organisation de l’Aviation Civile Internationale (OACI) prescrit des protocoles stricts pour le mouvement de données—mettant l’accent sur l’intégrité, la traçabilité, le chiffrement et la validation des données. Ces normes garantissent la sécurité, la fiabilité et la conformité dans la gestion des données opérationnelles, de maintenance et réglementaires. Une rigueur similaire s’applique à la santé, la finance et d’autres secteurs réglementés.

Le transfert (mouvement) de données est un levier stratégique de l’entreprise numérique, soutenant la résilience, l’agilité et la conformité. À mesure que les organisations modernisent leur infrastructure informatique et étendent leurs opérations, des stratégies de mouvement de données robustes, sécurisées et efficaces sont essentielles à leur réussite.

Pour un accompagnement expert sur les solutions de transfert de données, contactez notre équipe ou réservez une démo pour découvrir comment votre organisation peut bénéficier d’un mouvement de données moderne et automatisé.

Le transfert de données, également appelé mouvement de données, est le processus de déplacement, de copie ou de transmission de données entre des environnements numériques—tels que des bases de données, des systèmes de stockage, des plateformes cloud ou des applications. Il inclut des activités telles que la migration, la réplication, la synchronisation, l'intégration, le streaming et l'ingestion, garantissant que les données sont accessibles, cohérentes et sécurisées à travers des systèmes variés.

Le mouvement de données est essentiel pour assurer la continuité des activités, permettre l'analytique interplateformes, soutenir la reprise après sinistre, se conformer aux réglementations et alimenter la transformation numérique. Il permet aux organisations d'exploiter des informations à jour, d'intégrer des systèmes anciens et modernes, et de se remettre rapidement des perturbations.

Les principaux types sont la migration (déplacement de données entre systèmes), la réplication (création de copies pour une haute disponibilité), la synchronisation (maintien de la cohérence entre systèmes), l'intégration (combinaison de données provenant de sources multiples), le streaming (flux de données en temps réel), l'ingestion (consolidation des données dans des entrepôts centraux), ETL/ELT (extraction, transformation, chargement), et Reverse ETL (transfert des données des plateformes analytiques vers les systèmes opérationnels).

Les défis incluent la garantie de la sécurité et de la confidentialité des données, le maintien de l'intégrité et de la cohérence des données, la minimisation des temps d'arrêt lors des migrations, la gestion de volumes et vitesses élevés de données, la prise en charge des changements de schéma ou de format, la résolution de conflits dans des environnements distribués, et la conformité aux réglementations sectorielles.

Les protocoles incluent SFTP, HTTPS, SMB, NFS et des API cloud propriétaires, qui garantissent des transferts chiffrés et authentifiés. Les outils courants incluent AWS DMS, Oracle GoldenGate, Talend, Informatica, Apache Kafka, Fivetran, et bien d'autres, chacun étant adapté à des besoins spécifiques tels que la réplication, l'intégration, le streaming et la migration.

Prêt à moderniser vos solutions de transfert de données ? Améliorez la résilience, l'efficacité et la conformité avec un mouvement de données sécurisé et automatisé entre plateformes et clouds.

Le débit de transfert de données (DTR) définit la vitesse à laquelle les données numériques circulent à travers les canaux de communication, essentiel pour les ...

La fusion de données est le processus systématique d'intégration d'informations provenant de multiples sources—telles que des capteurs, des bases de données et ...

Un étalon de transfert est un étalon de mesure utilisé comme intermédiaire pour comparer des étalons de mesure à différents endroits ou niveaux, garantissant la...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.